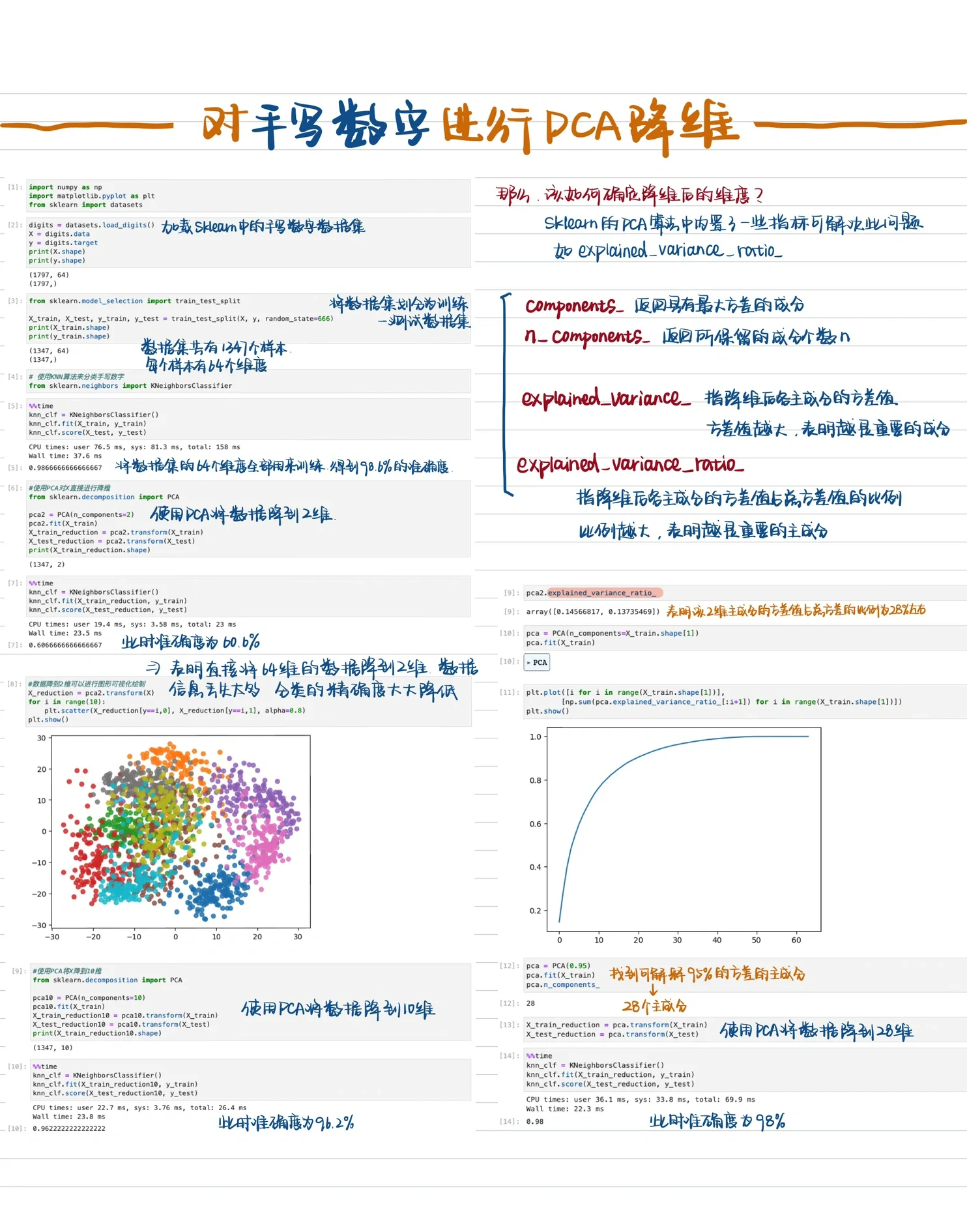

1、因此在有类别标签的数据上可能不如LDA表现优异 结果分析通过可视化或分类性能评估等方式,对比LDA和PCA降维后的效果通常情况下,若数据有类别标签,LDA降维后的分类性能会更好注意LDA降维的维度受限于类别数1,且可能过度拟合数据在实际应用中,需要根据数据特性和任务需求选择合适的降维算法;线性判别分析LDA是一种监督学习的降维技术,它的目标是将高维数据投影到低维空间中,使得不同类别的数据在低维空间中有较大的类间距离和较小的类内距离,从而实现分类数学公式可以通过以下几个步骤推导公式主成分分析PCA是一种无监督学习的降维技术,它的目标是将高维数据投影到低维空间;从理论上讲,降维方法可以分为两大类线性方法和非线性方法线性方法通过将数据从高维空间线性投影到低维空间,如主成分分析PCA和线性判别分析LDA然而,当数据集包含复杂的非线性结构时,线性方法可能无法充分捕捉数据的内在特性这时,非线性降维技术NLDR变得尤为重要本文将介绍10种;在实现上,PCA相对更简单直接,而LDA在计算最优解时需考虑额外约束数值稳定性问题在处理大量数据时尤为突出,LDA中通过奇异值分解可有效解决此外,PCA对数据进行去中心化处理后,其优化目标与方差最大化原理相一致,因此计算过程清晰且易于理解实际应用中,PCA和LDA分别适用于特征保留与分类任务选择;LDA的目标函数考虑pca和lda区别了数据的标签,因此在有类别标签的情况下,降维后的区分性更强与PCA的无监督性质不同,LDA是为有监督任务量身打造的,尤其适用于人脸识别等需要高区分度的任务在实际应用中,PCA常被用于音频处理中的降噪,而LDA则在区分个体声音时大显身手在人脸识别领域,PCA特征脸通过协。

2、在处理高维数据时,pca和lda区别我们经常面临着稀疏性和计算复杂度的挑战,这就是所谓的“维数灾难”为了克服这些问题,数据降维技术应运而生,它旨在将复杂的数据空间转化为低维子空间,提升样本密度和计算效率本文将深入探讨六种常见的数据降维方法PCALDAMDSISOMAPSNE和TSNE,以及它们的代码实现1;数据降维是一个复杂但重要的过程,选择方法取决于数据性质任务需求及计算成本建议先尝试简单方法如PCA或LDA,再根据需要探索更复杂的技术合理的超参数调整与对方法限制的理解是成功应用的关键在实践中,可针对特定技术进行实践经验分享,如调整tSNE的困惑度,观察数据结构的变化,或者通过可视化PCA的;LDA是一种线性分类器,LDA分类的一个目标是使得不同类别之间的距离越远越好,同一类别之中的距离越近越好主成分分析PCA与LDA有着非常近似的意思,LDA的输入数据是带标签的,而PCA的输入数据是不带标签的,所以PCA是一种unsupervised learningLDA通常来说是作为一个独立的算法存在,给定了训练数据;因为PCA不需要知道样本的类别,PCA的目的是使得降维后的样本方差最大LDA需要知道样本的类别标记,使得投影后的样本类内距离近,类之间距离远。

3、PCA 适用于无监督降维,LDA 适用于关注类可分性的监督问题,SVD 具有通用性,适用于包括协同过滤和矩阵分解在内的各种应用对比三种技术,PCA 强调最大化方差,LDA 则关注类之间的差异,而 SVD 则侧重于数据压缩和数值稳定性在实际应用中,选择技术取决于数据的具体目标和特征欢迎关注公众号 CV技术;总结而言,LDA与PCA在降维目标上存在本质区别,PCA追求方差最大化,适合无监督任务,而LDA利用类别信息最大化类间距离与最小化类内距离,适用于有监督任务,尤其在分类任务中表现出色;目标LDA的核心是最大化类间区分度的坐标轴成分方法通过将特征空间投影到一个维度更小的K维子空间,同时保持区分类别的信息原理将数据投影到更低维度空间,使同类点更加接近,异类点距离更远难点寻找合适的投影方式,使同类点完全分开特性LDA是有监督学习问题,与PCA不同,更注重分类。

4、LDA与PCA相比,具有监督学习的特性,能够利用类别信息进行降维两者在原理上相似,均依赖于矩阵特征分解,但LDA能更好地处理类别相关的数据分布,而PCA则更适合无监督学习场景LDA的优势包括利用类别先验知识进行降维,以及在样本分类信息依赖均值时表现更优然而,LDA的缺点也较为明显,如对非高斯分布数据;主成分分析PCA是一种线性变换技术,用于数据降维,广泛应用于股票预测基因表达分析等领域与线性判别分析LDA相比,PCA为无监督方法,无需标签信息,LDA则为有监督方法,需要标签信息PCA目标在于通过将数据集投影到低维空间,使得数据方差最大化在进行PCA降维时,首先对数据进行标准化,确保所有;PCA与线性判别分析LDA不同,LDA的目标是最大化群体间的距离以区分不同群体,而PCA则关注数据内部个体的差异PCA通过旋转坐标系,使得主成分表达式成为原始数据变差最大的方向基于协方差矩阵的主成分分析能够有效识别变量间的相互关系然而,如果变量数值差距过大,标准化数据进行主成分分析是必要的;2 PCA主要是从特征的协方差角度考虑,追求的是在降维之后能够最大化保持数据的内在信息 它不考虑分类信息,因此降低维度后,信息损失降到最低,但分类上可能会变得更加困难 LDA追求的是降维后的数据点尽可能容易被区分 降维后的样本数据在新的维度空间有最大的类间距离和最小的类内方差,数据;2 LDA的工作原理 LDA通过计算样本的类别数量均值向量和协方差矩阵等概念,来衡量类内样本的聚集度和类间的分离度 它使用散列值和类内类间散度矩阵来作为优化目标 通过拉格朗日乘子法,LDA能够仅利用样本均值和方差来确定最佳投影方向3 LDA与PCA的区别 PCA是一种无监督的降维方法,它;数据降维是数据处理中常用的技术,以下是几种常见的方法主成分分析PCA通过协方差矩阵的特征值分解,选择最重要的k个特征进行线性降维线性判别分析LDA通过寻找最佳投影方向,使类别间的距离最大化,同类别间的距离最小化,实现线性降维局部线性嵌入LLE保持邻域内数据点的线性关系。

还没有评论,来说两句吧...